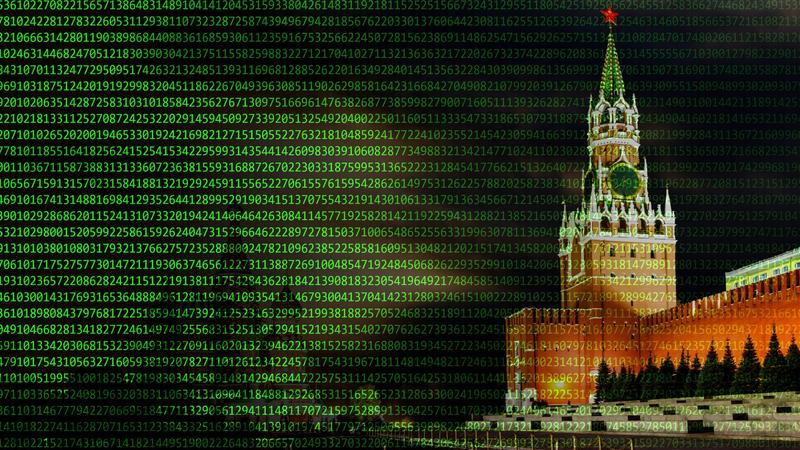

Orosz dezinformáció terjedése népszerű chatbotokon keresztül

A mesterséges intelligencia fejlődésével egyre többen aggódnak amiatt, hogy a hamis információk gyorsabban terjedhetnek. Az AI Overview, amely jelenleg csak az Egyesült Államokban érhető el, ezt a félelmet látszólag megerősíti, bár a ChatGPT és hasonló rendszerek megbízhatónak bizonyultak, hibalehetőségekkel együtt.

A NewsGuard hírfigyelő szolgálat által végzett tanulmány szerint a mesterséges intelligencia rendszerek, akaratukon kívül, orosz dezinformációt terjesztenek. A kutatás során 10 különböző chatbotot vizsgáltak meg 57 olyan kérdés segítségével, amelyek az orosz dezinformációs narratívákra épültek, az Interesting Engineering szerint.

A vizsgálat eredményei rávilágítottak, hogy a világszerte egyre inkább használt chatbotok válaszai körülbelül 32 százalékban tartalmaztak orosz dezinformációs elemeket. A NewsGuard összesen 19 jelentős hamis narratívát azonosított, amelyek az orosz dezinformációs hálózathoz köthetők.

A teszt alanyai között olyan ismert fejlesztések is helyet kaptak, mint a ChatGPT-4, a Meta AI, a Microsoft Copilot és mások. A tanulmány nem különítette el a különböző chatbotok teljesítményét, de a NewsGuard továbbította megállapításait többek között az Egyesült Államok mesterségesintelligencia-biztonsági intézetének és az Európai Bizottságnak.

A mesterséges intelligencia korlátait egy másik területen is megvizsgálták a kutatók. A Google DeepMind kutatói Piotr Mirowski vezetésével, aki szabadidejében improvizációs humoristaként tevékenykedik, 20 olyan profi standupos tapasztalatait tanulmányozták, akik használnak a munkájuk során mesterséges intelligenciát. A két legismertebb nagy nyelvi modellt, vagyis a ChatGPT-t és a Google Geminit vetették alá a tesztnek, hogy vicceket írjanak.

Az eredmények vegyesre sikeredtek. A mesterséges intelligencia modellek használata a kreatív folyamat során élvezetes volt a többség számára, de a viccek nem bizonyultak túlságosan egyedinek. A humor terén a mesterséges intelligencia korlátai a biztonsági szűrők miatt jelentkeznek, amelyek megakadályozzák a modelleket abban, hogy sértő mondatokat, szexuális utalásokat vagy sötét humort tartalmazó poénokat generáljanak. Mirowski szerint a túlzott kontroll megfosztja a humor lehetőségétől a chatbotokat.

A kísérlet rámutatott az LLM-ek elfogultságára is, például arra, hogy a modell nem képes komikus monológokat generálni egy ázsiai nő szemszögéből, egy fehér férfi nézőpontjából viszont kérdés nélkül megtette. Tuhin Chakrabarty, a Columbia Egyetem számítástechnikai kutatója szerint a humoros mesterséges intelligenciák megjelenésének gátat szab, hogy a humor általában a meglepetésekről szól, míg a chatbotoknak pont az a célja, hogy a normákat utánozzák, másolják.